Współzałożyciel Ethereum, Vitalik Buterin, dyskutował na temat bezpieczeństwa Web3, podkreślając jego rosnące znaczenie w świecie, w którym deepfaki stają się coraz bardziej powszechne.

9 lutego Buterin zacytował niedawny raport dotyczący firmy, która straciła 25 milionów dolarów. Stało się to, gdy pracownik finansowy został oszukany przez przekonującą, sfałszowaną rozmowę wideo.

Bezpieczeństwo Web3 podkreślone w zagrożeniach Deepfake

Deepfaki, czyli generowane przez sztuczną inteligencję fałszywe nagrania audio lub wideo, stają się coraz bardziej powszechne. Co więcej, sprawiają, że uwierzytelnianie ludzi wyłącznie na podstawie ich widzenia lub słyszenia jest niebezpieczne.

Buterin powiedział:

“Faktem jest, że od 2024 roku strumień audio lub nawet wideo danej osoby nie będzie już bezpiecznym sposobem uwierzytelnienia tego, kim jest.”

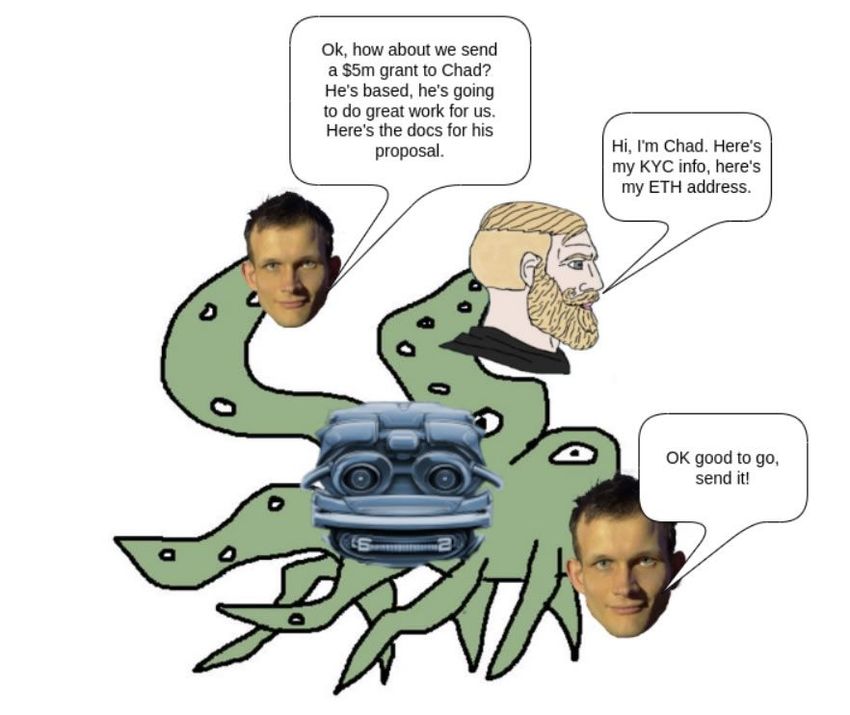

Metody kryptograficzne, takie jak podpisywanie wiadomości kluczami prywatnymi, nie są wystarczające, zauważył Buterin, wyjaśniając, że omijają one cel posiadania wielu sygnatariuszy weryfikujących tożsamość. Niemniej jednak, zadawanie spersonalizowanych “pytań bezpieczeństwa” opartych na wspólnych doświadczeniach jest skutecznym sposobem na uwierzytelnienie czyjejś tożsamości.

Dobre pytania są unikalne, trudne do odgadnięcia i sprawdzają “mikro” szczegóły, które ludzie pamiętają.

Buterin zasugerował:

“Ludzie często przestają angażować się w praktyki bezpieczeństwa, jeśli są one nudne i monotonne, więc dobrze jest sprawić, by pytania bezpieczeństwa były zabawne.”

Pytania bezpieczeństwa powinny być łączone z innymi technikami, powiedział. Mogą one obejmować wcześniej uzgodnione słowa kodowe, wielokanałowe potwierdzanie informacji, zabezpieczenia przed atakami typu man-in-the-middle oraz opóźnienia lub ograniczenia nieodwracalnych działań.

Indywidualne pytania bezpieczeństwa różnią się od pytań bezpieczeństwa między przedsiębiorstwami, takimi jak bankowe pytania bezpieczeństwa, i powinny być dostosowane do zaangażowanych osób.

Buterin stwierdził, że żadna technika nie jest idealna. Jednak techniki warstwowe dostosowane do sytuacji mogą zapewnić skuteczne bezpieczeństwo Web3 nawet w świecie, w którym audio i wideo mogą być sfałszowane.

Buterin podkreślił:

“W świecie post-deepfake musimy dostosować nasze strategie do nowej rzeczywistości tego, co jest teraz łatwe do sfałszowania, a co pozostaje trudne do sfałszowania, ale tak długo, jak to robimy, zachowanie bezpieczeństwa jest nadal całkiem możliwe.”

9 lutego poinformowano, że fałszywe głosy, obrazy i inne zmanipulowane treści online miały już negatywny wpływ na tegoroczne wybory w USA. Ujawniono, że Biały Dom szuka sposobów na weryfikację całej swojej komunikacji i zapobieganie różnym formom generatywnego fałszowania, manipulacji i nadużyć sztucznej inteligencji.

W ubiegłym miesiącu Światowe Forum Ekonomiczne (WEF) ujawniło, że dezinformacja i fałszerstwa generowane przez sztuczną inteligencję są największym krótkoterminowym zagrożeniem na świecie. Również w styczniu założyciel MicroStrategy, Michael Saylor, ostrzegł przed deepfake’ami, w których próbował wyłudzić od użytkowników ich Bitcoiny.